Transformer是目前最流行的深度学习架构之一,广泛应用于大语言模型(LLM)和计算机视觉等领域。

它的核心创新在于引入了自注意力机制(Self-Attention),使得模型能够更好地捕捉输入数据中的长距离依赖关系。

可视化Transformer

扩展链接-可视化Transformer

Transformer是目前最流行的深度学习架构之一,广泛应用于大语言模型(LLM)和计算机视觉等领域。

它的核心创新在于引入了自注意力机制(Self-Attention),使得模型能够更好地捕捉输入数据中的长距离依赖关系。

可视化Transformer

扩展链接-可视化Transformer

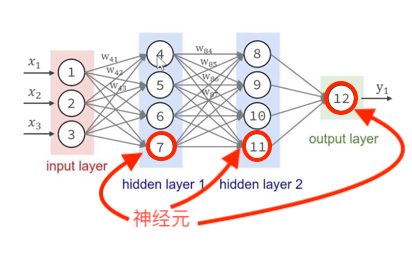

神经网络就是模仿人脑神经元的结构,其典型应用就是Transformer架构。

神经网络由输入层、隐藏层和输出层组成。

每一层由多个神经元组成,神经元之间通过权重连接。

输入层接收外部数据,隐藏层进行特征提取和变换,输出层产生最终结果。

贪心算法

nums,你最初位于数组的第一个位置。数组中的每个元素代表你在该位置可以跳跃的最大长度。判断你是否能够到达最后一个位置。mx,表示当前能够跳跃到的最远位置。我们从数组的第一个位置开始,逐步更新 mx 的值。i,我们首先检查是否能够到达该位置,即 i 是否小于或等于 mx。如果不能到达该位置,说明我们无法继续前进,直接返回 false。mx 的值,取当前的 mx 和 i + nums[i] 的最大值。这样,我们就能够知道在当前位置能够跳跃到的最远位置。mx 的值大于或等于数组的最后一个位置,说明我们能够到达最后一个位置,返回 true。否则,返回 false。动态规划

prices,其中 prices[i] 是一支给定股票第 i 天的价格。你只能选择某一天买入这只股票,并选择在未来的某一个不同的日子卖出该股票。0。minPrice,另一个是当前的最大利润 ans。num,我们首先计算当前价格与 minPrice 之间的利润,并更新 ans 为当前利润和之前最大利润的较大值。然后,我们更新 minPrice 为当前价格和之前最小价格的较小值。ans。桶排序

n + 1,其中 n 是输入数组的长度。k 个元素为止。这样,我们就可以得到出现频率前 k高的元素。排序

nums 和整数 k,返回数组中第 k 个最大的元素。nums 进行排序,然后直接返回排序后数组中第 k 个最大的元素。k 个最大的元素位于数组的倒数第 k 个位置,即 nums[nums.length - k]。k 个元素的时间复杂度是 O(1)。暴力搜索

T,表示每天的温度,返回一个数组 res,其中 res[i] 是指对于第 i 天,至少过了多少天之后,温度才会升高。如果之后都不会升高,请在该位置用 0 来代替。res 数组中。如果遍历到数组末尾仍然没有找到比当前天温度高的日子,我们就将 res[i] 设置为 0。res 数组。递归

Character.isLetter() 方法用于判断指定的字符是否为字母。

StringBuilder.append() 方法用于将指定的字符串追加到此字符序列。

StringBuilder.toString() 方法用于将此字符序列转换为一个字符串。

StringBuilder() 构造方法用于创建一个空的 StringBuilder 对象。

StringBuilder.repeat() 方法用于创建一个新的字符串,该字符串是通过重复当前字符串指定次数得到的。

StringBuilder.repeat(String str, int count) 方法用于创建一个新的字符串,该字符串是通过重复指定字符串指定次数得到的。

String.substring() 方法用于返回一个新的字符串,它是此字符串的一个子字符串。

String.charAt() 方法用于返回指定索引处的字符。

String.isEmpty() 方法用于判断字符串是否为空。

Integer.parseInt() 方法用于将字符串参数解析为一个整数。

栈

栈

'(',')','{','}','[',']' 的字符串,判断字符串是否有效。有效字符串需满足: